私的AI研究会 > NCAppMake

OpenVINO™ 付属のデモを修正する †

OpenVINO™ ツールキット「2021.4」版でほとんどのデモソフトが起動した最初だけウインドウ表示が小さく部分表示になるようになった。

付属のデモプログラムの修正手順を確認する。

※ 最終更新:2021/08/20

事前準備 †

プログラムの場所 †

▼ /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/ 詳細

▲ /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/ 詳細

/opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/

├── 3d_segmentation_demo

│ └── python

│ ├── 3d_segmentation_demo.py

│ ├── README.md

│ ├── models.lst

│ └── requirements.txt

├── CMakeLists.txt

├── README.md

├── action_recognition_demo

│ └── python

│ ├── README.md

│ ├── action_recognition.gif

│ ├── action_recognition_demo

│ │ ├── __init__.py

│ │ ├── meters.py

│ │ ├── models.py

│ │ ├── pipeline.py

│ │ ├── queue.py

│ │ ├── result_renderer.py

│ │ ├── steps.py

│ │ └── timer.py

│ ├── action_recognition_demo.py

│ ├── driver_actions.txt

│ ├── models.lst

│ └── weld_defects.txt

├── bert_named_entity_recognition_demo

│ └── python

│ ├── README.md

│ ├── bert_named_entity_recognition_demo.py

│ └── models.lst

├── bert_question_answering_demo

│ └── python

│ ├── README.md

│ ├── bert_question_answering_demo.py

│ ├── models.lst

│ └── requirements.txt

├── bert_question_answering_embedding_demo

│ └── python

│ ├── README.md

│ ├── bert_question_answering_embedding_demo.py

│ ├── models.lst

│ └── requirements.txt

├── build_demos.sh

├── classification_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── grid_mat.hpp

│ ├── main.cpp

│ └── models.lst

├── colorization_demo

│ └── python

│ ├── README.md

│ ├── colorization_demo.py

│ └── models.lst

├── common

│ ├── cpp

│ │ ├── CMakeLists.txt

│ │ ├── models

│ │ │ ├── CMakeLists.txt

│ │ │ ├── include

│ │ │ │ └── models

│ │ │ │ ├── associative_embedding_decoder.h

│ │ │ │ ├── classification_model.h

│ │ │ │ ├── deblurring_model.h

│ │ │ │ ├── detection_model.h

│ │ │ │ ├── detection_model_centernet.h

│ │ │ │ ├── detection_model_faceboxes.h

│ │ │ │ ├── detection_model_retinaface.h

│ │ │ │ ├── detection_model_ssd.h

│ │ │ │ ├── detection_model_yolo.h

│ │ │ │ ├── hpe_model_associative_embedding.h

│ │ │ │ ├── hpe_model_openpose.h

│ │ │ │ ├── image_model.h

│ │ │ │ ├── input_data.h

│ │ │ │ ├── internal_model_data.h

│ │ │ │ ├── model_base.h

│ │ │ │ ├── openpose_decoder.h

│ │ │ │ ├── results.h

│ │ │ │ ├── segmentation_model.h

│ │ │ │ └── super_resolution_model.h

│ │ │ └── src

│ │ │ ├── associative_embedding_decoder.cpp

│ │ │ ├── classification_model.cpp

│ │ │ ├── deblurring_model.cpp

│ │ │ ├── detection_model.cpp

│ │ │ ├── detection_model_centernet.cpp

│ │ │ ├── detection_model_faceboxes.cpp

│ │ │ ├── detection_model_retinaface.cpp

│ │ │ ├── detection_model_ssd.cpp

│ │ │ ├── detection_model_yolo.cpp

│ │ │ ├── hpe_model_associative_embedding.cpp

│ │ │ ├── hpe_model_openpose.cpp

│ │ │ ├── image_model.cpp

│ │ │ ├── model_base.cpp

│ │ │ ├── openpose_decoder.cpp

│ │ │ ├── segmentation_model.cpp

│ │ │ └── super_resolution_model.cpp

│ │ ├── monitors

│ │ │ ├── CMakeLists.txt

│ │ │ ├── include

│ │ │ │ └── monitors

│ │ │ │ ├── cpu_monitor.h

│ │ │ │ ├── memory_monitor.h

│ │ │ │ └── presenter.h

│ │ │ └── src

│ │ │ ├── cpu_monitor.cpp

│ │ │ ├── memory_monitor.cpp

│ │ │ ├── presenter.cpp

│ │ │ ├── query_wrapper.cpp

│ │ │ └── query_wrapper.h

│ │ ├── pipelines

│ │ │ ├── CMakeLists.txt

│ │ │ ├── include

│ │ │ │ └── pipelines

│ │ │ │ ├── async_pipeline.h

│ │ │ │ ├── metadata.h

│ │ │ │ └── requests_pool.h

│ │ │ └── src

│ │ │ ├── async_pipeline.cpp

│ │ │ └── requests_pool.cpp

│ │ └── utils

│ │ ├── CMakeLists.txt

│ │ ├── include

│ │ │ └── utils

│ │ │ ├── args_helper.hpp

│ │ │ ├── common.hpp

│ │ │ ├── config_factory.h

│ │ │ ├── default_flags.hpp

│ │ │ ├── grid_mat.hpp

│ │ │ ├── images_capture.h

│ │ │ ├── input_wrappers.hpp

│ │ │ ├── kuhn_munkres.hpp

│ │ │ ├── nms.hpp

│ │ │ ├── ocv_common.hpp

│ │ │ ├── performance_metrics.hpp

│ │ │ ├── slog.hpp

│ │ │ └── threads_common.hpp

│ │ └── src

│ │ ├── args_helper.cpp

│ │ ├── config_factory.cpp

│ │ ├── images_capture.cpp

│ │ ├── kuhn_munkres.cpp

│ │ ├── performance_metrics.cpp

│ │ └── w_dirent.hpp

│ └── python

│ ├── helpers.py

│ ├── html_reader.py

│ ├── images_capture.py

│ ├── models

│ │ ├── __init__.py

│ │ ├── centernet.py

│ │ ├── ctpn.py

│ │ ├── deblurring.py

│ │ ├── faceboxes.py

│ │ ├── hpe_associative_embedding.py

│ │ ├── model.py

│ │ ├── open_pose.py

│ │ ├── retinaface.py

│ │ ├── segmentation.py

│ │ ├── ssd.py

│ │ ├── ultra_lightweight_face_detection.py

│ │ ├── utils.py

│ │ └── yolo.py

│ ├── monitors.py

│ ├── monitors_extension

│ │ ├── CMakeLists.txt

│ │ └── monitors_extension.cpp

│ ├── performance_metrics.py

│ ├── pipelines

│ │ ├── __init__.py

│ │ └── async_pipeline.py

│ └── tokens_bert.py

├── crossroad_camera_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── crossroad_camera.gif

│ ├── crossroad_camera_demo.hpp

│ ├── main.cpp

│ └── models.lst

├── deblurring_demo

│ └── python

│ ├── README.md

│ ├── deblurred_image.png

│ ├── deblurring_demo.py

│ └── models.lst

├── face_detection_mtcnn_demo

│ └── python

│ ├── README.md

│ ├── face_detection_mtcnn_demo.py

│ ├── models.lst

│ ├── mtcnn_utils.py

│ └── test.jpg

├── face_recognition_demo

│ └── python

│ ├── README.md

│ ├── __init__.py

│ ├── face_detector.py

│ ├── face_identifier.py

│ ├── face_recognition_demo.py

│ ├── faces_database.py

│ ├── ie_module.py

│ ├── landmarks_detector.py

│ ├── models.lst

│ ├── requirements.txt

│ └── utils.py

├── formula_recognition_demo

│ └── python

│ ├── README.md

│ ├── demo_intro.gif

│ ├── formula_recognition_demo.py

│ ├── interactive_interface.png

│ ├── models.lst

│ ├── requirements.txt

│ ├── sample.png

│ ├── sample2.png

│ └── utils.py

├── gaze_estimation_demo

│ ├── cpp

│ │ ├── CMakeLists.txt

│ │ ├── README.md

│ │ ├── gaze_estimation_demo.hpp

│ │ ├── include

│ │ │ ├── base_estimator.hpp

│ │ │ ├── exponential_averager.hpp

│ │ │ ├── eye_state_estimator.hpp

│ │ │ ├── face_detector.hpp

│ │ │ ├── face_inference_results.hpp

│ │ │ ├── gaze_estimator.hpp

│ │ │ ├── head_pose_estimator.hpp

│ │ │ ├── ie_wrapper.hpp

│ │ │ ├── landmarks_estimator.hpp

│ │ │ ├── results_marker.hpp

│ │ │ └── utils.hpp

│ │ ├── main.cpp

│ │ ├── models.lst

│ │ └── src

│ │ ├── exponential_averager.cpp

│ │ ├── eye_state_estimator.cpp

│ │ ├── face_detector.cpp

│ │ ├── face_inference_results.cpp

│ │ ├── gaze_estimator.cpp

│ │ ├── head_pose_estimator.cpp

│ │ ├── ie_wrapper.cpp

│ │ ├── landmarks_estimator.cpp

│ │ ├── results_marker.cpp

│ │ └── utils.cpp

│ ├── cpp_gapi

│ │ ├── CMakeLists.txt

│ │ ├── README.md

│ │ ├── gaze_estimation_demo_gapi.hpp

│ │ ├── include

│ │ │ ├── custom_kernels.hpp

│ │ │ ├── exponential_averager.hpp

│ │ │ ├── face_inference_results.hpp

│ │ │ ├── kernel_packages.hpp

│ │ │ ├── results_marker.hpp

│ │ │ ├── stream_source.hpp

│ │ │ └── utils.hpp

│ │ ├── main.cpp

│ │ ├── models.lst

│ │ └── src

│ │ ├── custom_kerenels.cpp

│ │ ├── exponential_averager.cpp

│ │ ├── face_inference_results.cpp

│ │ ├── results_marker.cpp

│ │ └── utils.cpp

│ └── gaze_estimation.gif

├── gesture_recognition_demo

│ └── python

│ ├── README.md

│ ├── gesture_recognition.gif

│ ├── gesture_recognition_demo

│ │ ├── __init__.py

│ │ ├── action_recognizer.py

│ │ ├── common.py

│ │ ├── person_detector.py

│ │ ├── tracker.py

│ │ ├── video_library.py

│ │ ├── video_stream.py

│ │ └── visualizer.py

│ ├── gesture_recognition_demo.py

│ └── models.lst

├── handwritten_text_recognition_demo

│ └── python

│ ├── README.md

│ ├── data

│ │ ├── digit_hyphen.txt

│ │ ├── handwritten_japanese_test.png

│ │ └── handwritten_simplified_chinese_test.png

│ ├── handwritten_text_recognition_demo.py

│ ├── models.lst

│ ├── requirements.txt

│ └── utils

│ ├── __init__.py

│ └── codec.py

├── human_pose_estimation_3d_demo

│ └── python

│ ├── README.md

│ ├── data

│ │ └── extrinsics.json

│ ├── human_pose_estimation_3d.gif

│ ├── human_pose_estimation_3d_canvas.gif

│ ├── human_pose_estimation_3d_demo.py

│ ├── models.lst

│ ├── modules

│ │ ├── __init__.py

│ │ ├── draw.py

│ │ ├── inference_engine.py

│ │ ├── one_euro_filter.py

│ │ ├── parse_poses.py

│ │ └── pose.py

│ ├── pose_extractor

│ │ ├── CMakeLists.txt

│ │ ├── src

│ │ │ ├── extract_poses.cpp

│ │ │ ├── extract_poses.hpp

│ │ │ ├── human_pose.cpp

│ │ │ ├── human_pose.hpp

│ │ │ ├── peak.cpp

│ │ │ └── peak.hpp

│ │ └── wrapper.cpp

│ └── requirements.txt

├── human_pose_estimation_demo

│ ├── cpp

│ │ ├── CMakeLists.txt

│ │ ├── README.md

│ │ ├── main.cpp

│ │ └── models.lst

│ ├── human_pose_estimation.gif

│ └── python

│ ├── README.md

│ ├── human_pose_estimation_demo.py

│ └── models.lst

├── image_inpainting_demo

│ └── python

│ ├── README.md

│ ├── car_1_example.png

│ ├── image_inpainting_demo.py

│ ├── inpainting.py

│ ├── inpainting_gui.py

│ └── models.lst

├── image_processing_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── assets

│ │ ├── deblurred_image.png

│ │ ├── street_640x360.png

│ │ ├── street_resized.png

│ │ └── street_resolution.png

│ ├── main.cpp

│ ├── models.lst

│ ├── visualizer.cpp

│ └── visualizer.hpp

├── image_retrieval_demo

│ └── python

│ ├── README.md

│ ├── image_retrieval.gif

│ ├── image_retrieval_demo

│ │ ├── __init__.py

│ │ ├── common.py

│ │ ├── image_retrieval.py

│ │ ├── roi_cv_detector

│ │ │ ├── __init__.py

│ │ │ └── detect_by_simple_dense_optical_flow.py

│ │ ├── roi_detector_on_video.py

│ │ └── visualizer.py

│ ├── image_retrieval_demo.py

│ └── models.lst

├── image_translation_demo

│ └── python

│ ├── README.md

│ ├── image_translation_demo

│ │ ├── __init__.py

│ │ ├── models.py

│ │ ├── postprocessing.py

│ │ └── preprocessing.py

│ ├── image_translation_demo.py

│ └── models.lst

├── instance_segmentation_demo

│ └── python

│ ├── README.md

│ ├── instance_segmentation.gif

│ ├── instance_segmentation_demo

│ │ ├── __init__.py

│ │ ├── model_utils.py

│ │ ├── tracker.py

│ │ └── visualizer.py

│ ├── instance_segmentation_demo.py

│ └── models.lst

├── interactive_face_detection_demo

│ ├── cpp

│ │ ├── CMakeLists.txt

│ │ ├── README.md

│ │ ├── detectors.cpp

│ │ ├── detectors.hpp

│ │ ├── face.cpp

│ │ ├── face.hpp

│ │ ├── interactive_face_detection.hpp

│ │ ├── main.cpp

│ │ ├── models.lst

│ │ ├── visualizer.cpp

│ │ └── visualizer.hpp

│ ├── cpp_gapi

│ │ ├── CMakeLists.txt

│ │ ├── README.md

│ │ ├── face.cpp

│ │ ├── face.hpp

│ │ ├── interactive_face_detection_gapi.hpp

│ │ ├── main.cpp

│ │ ├── models.lst

│ │ ├── utils.hpp

│ │ ├── visualizer.cpp

│ │ └── visualizer.hpp

│ └── interactive_face_detection.gif

├── machine_translation_demo

│ └── python

│ ├── README.md

│ ├── machine_translation_demo.py

│ ├── models.lst

│ └── requirements.txt

├── mask_rcnn_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── main.cpp

│ ├── mask_rcnn_demo.h

│ └── models.lst

├── monodepth_demo

│ └── python

│ ├── README.md

│ ├── disp.png

│ ├── models.lst

│ └── monodepth_demo.py

├── multi_camera_multi_target_tracking_demo

│ └── python

│ ├── README.md

│ ├── configs

│ │ ├── person.py

│ │ └── vehicle.py

│ ├── mc_tracker

│ │ ├── mct.py

│ │ └── sct.py

│ ├── models.lst

│ ├── multi_camera_multi_target_tracking_demo.py

│ ├── requirements.txt

│ ├── run_evaluate.py

│ ├── run_history_visualize.py

│ └── utils

│ ├── __init__.py

│ ├── analyzer.py

│ ├── ie_tools.py

│ ├── misc.py

│ ├── network_wrappers.py

│ ├── segm_postprocess.py

│ ├── video.py

│ └── visualization.py

├── multi_channel_common

│ └── cpp

│ ├── CMakeLists.txt

│ ├── decoder.cpp

│ ├── decoder.hpp

│ ├── graph.cpp

│ ├── graph.hpp

│ ├── input.cpp

│ ├── input.hpp

│ ├── multicam

│ │ ├── CMakeLists.txt

│ │ ├── camera.cpp

│ │ ├── camera.hpp

│ │ ├── controller.cpp

│ │ ├── controller.hpp

│ │ ├── utils.cpp

│ │ └── utils.hpp

│ ├── multichannel_params.hpp

│ ├── output.cpp

│ ├── output.hpp

│ ├── perf_timer.cpp

│ ├── perf_timer.hpp

│ ├── threading.cpp

│ └── threading.hpp

├── multi_channel_face_detection_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── main.cpp

│ ├── models.lst

│ └── multichannel_face_detection_params.hpp

├── multi_channel_human_pose_estimation_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── human_pose.cpp

│ ├── human_pose.hpp

│ ├── main.cpp

│ ├── models.lst

│ ├── peak.cpp

│ ├── peak.hpp

│ ├── postprocess.cpp

│ ├── postprocess.hpp

│ ├── postprocessor.cpp

│ ├── postprocessor.hpp

│ ├── render_human_pose.cpp

│ └── render_human_pose.hpp

├── multi_channel_object_detection_demo_yolov3

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── main.cpp

│ ├── models.lst

│ └── multichannel_object_detection_demo_yolov3_params.hpp

├── noise_suppression_demo

│ └── python

│ ├── README.md

│ ├── models.lst

│ └── noise_suppression_demo.py

├── object_detection_demo

│ ├── cpp

│ │ ├── CMakeLists.txt

│ │ ├── README.md

│ │ ├── main.cpp

│ │ └── models.lst

│ ├── object_detection.gif

│ └── python

│ ├── README.md

│ ├── models.lst

│ └── object_detection_demo.py

├── pedestrian_tracker_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── include

│ │ ├── cnn.hpp

│ │ ├── core.hpp

│ │ ├── descriptor.hpp

│ │ ├── detector.hpp

│ │ ├── distance.hpp

│ │ ├── logging.hpp

│ │ ├── pedestrian_tracker_demo.hpp

│ │ ├── tracker.hpp

│ │ └── utils.hpp

│ ├── main.cpp

│ ├── models.lst

│ ├── pedestrian_tracker.gif

│ └── src

│ ├── cnn.cpp

│ ├── detector.cpp

│ ├── distance.cpp

│ ├── tracker.cpp

│ └── utils.cpp

├── place_recognition_demo

│ └── python

│ ├── README.md

│ ├── models.lst

│ ├── place_recognition_demo

│ │ ├── __init__.py

│ │ ├── common.py

│ │ ├── place_recognition.py

│ │ └── visualizer.py

│ └── place_recognition_demo.py

├── requirements.txt

├── security_barrier_camera_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── main.cpp

│ ├── models.lst

│ ├── net_wrappers.hpp

│ ├── security_barrier_camera.gif

│ └── security_barrier_camera_demo.hpp

├── segmentation_demo

│ ├── cpp

│ │ ├── CMakeLists.txt

│ │ ├── README.md

│ │ ├── main.cpp

│ │ └── models.lst

│ ├── python

│ │ ├── README.md

│ │ ├── models.lst

│ │ └── segmentation_demo.py

│ └── segmentation.gif

├── single_human_pose_estimation_demo

│ └── python

│ ├── README.md

│ ├── detector.py

│ ├── estimator.py

│ ├── models.lst

│ ├── single_human_pose_estimation.gif

│ └── single_human_pose_estimation_demo.py

├── smart_classroom_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── action_event_metrics.py

│ ├── create_list.py

│ ├── include

│ │ ├── action_detector.hpp

│ │ ├── actions.hpp

│ │ ├── cnn.hpp

│ │ ├── detector.hpp

│ │ ├── face_reid.hpp

│ │ ├── logger.hpp

│ │ ├── smart_classroom_demo.hpp

│ │ └── tracker.hpp

│ ├── main.cpp

│ ├── models.lst

│ ├── smart_classroom.gif

│ └── src

│ ├── action_detector.cpp

│ ├── align_transform.cpp

│ ├── cnn.cpp

│ ├── detector.cpp

│ ├── logger.cpp

│ ├── reid_gallery.cpp

│ └── tracker.cpp

├── social_distance_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── include

│ │ ├── geodist.hpp

│ │ ├── net_wrappers.hpp

│ │ ├── person_trackers.hpp

│ │ └── social_distance_demo.hpp

│ ├── main.cpp

│ ├── models.lst

│ ├── social_distance.gif

│ └── src

│ └── geodist.cpp

├── sound_classification_demo

│ └── python

│ ├── README.md

│ ├── models.lst

│ └── sound_classification_demo.py

├── speech_recognition_deepspeech_demo

│ └── python

│ ├── README.md

│ ├── asr_utils

│ │ ├── __init__.py

│ │ ├── audio_features.py

│ │ ├── ctc_decoder_seq_pipeline.py

│ │ ├── deep_speech_seq_pipeline.py

│ │ ├── pipelines.py

│ │ ├── profiles.py

│ │ └── rnn_seq_pipeline.py

│ ├── ctcdecode-numpy

│ │ ├── CMakeLists.txt

│ │ ├── LICENSE

│ │ ├── README.md

│ │ ├── ctcdecode_numpy

│ │ │ ├── __init__.py

│ │ │ ├── binding.cpp

│ │ │ ├── binding.h

│ │ │ ├── ctc_beam_search_decoder.cpp

│ │ │ ├── ctc_beam_search_decoder.h

│ │ │ ├── decoder_utils.cpp

│ │ │ ├── decoder_utils.h

│ │ │ ├── decoders.i

│ │ │ ├── decoders_wrap.cpp

│ │ │ ├── impl.py

│ │ │ ├── numpy.i

│ │ │ ├── output.h

│ │ │ ├── path_trie.cpp

│ │ │ ├── path_trie.h

│ │ │ ├── scorer_base.cpp

│ │ │ ├── scorer_base.h

│ │ │ ├── scorer_yoklm.cpp

│ │ │ ├── scorer_yoklm.h

│ │ │ ├── word_prefix_set.cpp

│ │ │ ├── word_prefix_set.h

│ │ │ └── yoklm

│ │ │ ├── kenlm_v5_loader.cpp

│ │ │ ├── kenlm_v5_loader.hpp

│ │ │ ├── language_model.cpp

│ │ │ ├── language_model.hpp

│ │ │ ├── memory_section.cpp

│ │ │ ├── memory_section.hpp

│ │ │ ├── sorted_search.hpp

│ │ │ ├── vocabulary.cpp

│ │ │ ├── vocabulary.hpp

│ │ │ └── word_index.hpp

│ │ ├── setup.py

│ │ └── third_party

│ │ └── ThreadPool

│ │ ├── COPYING

│ │ ├── README.md

│ │ ├── ThreadPool.h

│ │ └── commit.txt

│ ├── default_alphabet_example.conf

│ ├── models.lst

│ ├── profile_example.yml

│ ├── requirements.txt

│ └── speech_recognition_deepspeech_demo.py

├── speech_recognition_quartznet_demo

│ └── python

│ ├── README.md

│ ├── models.lst

│ └── speech_recognition_quartznet_demo.py

├── text_detection_demo

│ └── cpp

│ ├── CMakeLists.txt

│ ├── README.md

│ ├── include

│ │ ├── cnn.hpp

│ │ ├── text_detection.hpp

│ │ └── text_recognition.hpp

│ ├── main.cpp

│ ├── models.lst

│ ├── src

│ │ ├── cnn.cpp

│ │ ├── text_detection.cpp

│ │ └── text_recognition.cpp

│ ├── text_detection_demo.hpp

│ └── text_detection_demo.jpg

├── text_spotting_demo

│ └── python

│ ├── README.md

│ ├── models.lst

│ ├── text_spotting_demo

│ │ ├── __init__.py

│ │ ├── tracker.py

│ │ └── visualizer.py

│ ├── text_spotting_demo.jpg

│ └── text_spotting_demo.py

├── text_to_speech_demo

│ └── python

│ ├── README.md

│ ├── models

│ │ ├── __init__.py

│ │ ├── forward_tacotron_ie.py

│ │ └── mel2wave_ie.py

│ ├── models.lst

│ ├── requirements.txt

│ ├── text_to_speech_demo.py

│ └── utils

│ ├── __init__.py

│ ├── embeddings_processing.py

│ ├── gui.py

│ ├── numbers.py

│ ├── text_preprocessing.py

│ └── wav_processing.py

├── thirdparty

│ └── gflags

│ ├── AUTHORS.txt

│ ├── BUILD

│ ├── CMakeLists.txt

│ ├── COPYING.txt

│ ├── ChangeLog.txt

│ ├── INSTALL.md

│ ├── README.md

│ ├── WORKSPACE

│ ├── appveyor.yml

│ ├── bazel

│ │ └── gflags.bzl

│ ├── cmake

│ │ ├── README_runtime.txt

│ │ ├── cmake_uninstall.cmake.in

│ │ ├── config.cmake.in

│ │ ├── execute_test.cmake

│ │ ├── package.cmake.in

│ │ ├── package.pc.in

│ │ ├── utils.cmake

│ │ └── version.cmake.in

│ ├── src

│ │ ├── config.h

│ │ ├── defines.h.in

│ │ ├── gflags.cc

│ │ ├── gflags.h.in

│ │ ├── gflags_completions.cc

│ │ ├── gflags_completions.h.in

│ │ ├── gflags_completions.sh

│ │ ├── gflags_declare.h.in

│ │ ├── gflags_ns.h.in

│ │ ├── gflags_reporting.cc

│ │ ├── mutex.h

│ │ ├── util.h

│ │ ├── windows_port.cc

│ │ └── windows_port.h

│ └── test

│ ├── CMakeLists.txt

│ ├── config

│ │ ├── CMakeLists.txt

│ │ └── main.cc

│ ├── flagfile.1

│ ├── flagfile.2

│ ├── flagfile.3

│ ├── gflags_build.py.in

│ ├── gflags_declare_flags.cc

│ ├── gflags_declare_test.cc

│ ├── gflags_strip_flags_test.cc

│ ├── gflags_strip_flags_test.cmake

│ ├── gflags_unittest.cc

│ ├── gflags_unittest_flagfile

│ └── nc

│ ├── CMakeLists.txt

│ └── gflags_nc.cc

├── time_series_forecasting_demo

│ └── python

│ ├── README.md

│ ├── models.lst

│ ├── requirements.txt

│ ├── time_series_forecasting_demo.jpg

│ └── time_series_forecasting_demo.py

└── whiteboard_inpainting_demo

└── python

├── README.md

├── cityscapes_labels.txt

├── coco_labels.txt

├── models.lst

├── requirements.txt

├── utils

│ ├── __init__.py

│ ├── ie_tools.py

│ ├── misc.py

│ ├── network_wrappers.py

│ └── segm_postprocess.py

├── whiteboard_inpainting.gif

└── whiteboard_inpainting_demo.py

Python プログラムの修正 †

- ホームディレクトリに「~/omz_demos_python/」を作成。

- それぞれの <デモプログラム名>/python/ フォルダごと「~/omz_demos_python/」にコピーする。

- 「~/omz_demos_python/」内のソースファイルを修正して実行すれば OK。

- 「~/run_app2/」-スクリプトは「~/omz_demos_python/」に対応ファイルがなければオリジナルの場所「/opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/」以下のファイルで実行する。

$ vi ~/omz_demos_python/human_pose_estimation_3d_demo/python/human_pose_estimation_3d_demo.py

151

152 if not args.no_show:

153 cv2.imshow(canvas_3d_window_name, canvas_3d)

154 cv2.namedWindow('3D Human Pose Estimation', cv2.WINDOW_AUTOSIZE) # 2021/0819

155 cv2.imshow('3D Human Pose Estimation', frame)

156

$ vi /omz_demos_python/action_recognition_demo/python/action_recognition_demo/result_renderer.py

104 if not self.no_show:

105 cv2.namedWindow("Action Recognition", cv2.WINDOW_AUTOSIZE) # 2021/0819

106 cv2.imshow("Action Recognition", frame)

107 key = cv2.waitKey(1) & 0xFF

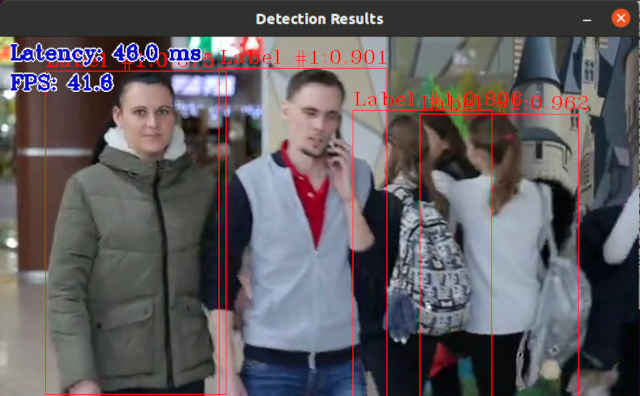

$ vi ~/omz_demos_python/object_detection_demo/python/python/object_detection_demo.py

276

277 if not args.no_show:

278 cv2.namedWindow('Detection Results', cv2.WINDOW_AUTOSIZE) # 2021/0819

279 cv2.imshow('Detection Results', frame)

280 key = cv2.waitKey(1)

281

:

335

336 if not args.no_show:

337 cv2.namedWindow('Detection Results', cv2.WINDOW_AUTOSIZE) # 2021/0819

338 cv2.imshow('Detection Results', frame)

339 key = cv2.waitKey(1)

340

$ vi ~/omz_demos_python/human_pose_estimation_demo/python/human_pose_estimation_demo.py

224 if not args.no_show:

225 cv2.namedWindow('Pose estimation results', cv2.WINDOW_AUTOSIZE) # 2021/0819

226 cv2.imshow('Pose estimation results', frame)

227 key = cv2.waitKey(1)

228

$ vi ~/omz_demos_python/gesture_recognition_demo/python/gesture_recognition_demo/visualizer.py

99 frame = frame_queue.get(True)

100

101 cv2.namedWindow(name, cv2.WINDOW_AUTOSIZE) # 2021/0819

102 cv2.imshow(name, frame)

103

修正なし

$ vi ~/omz_demos_python/single_human_pose_estimation_demo/python/single_human_pose_estimation_demo.py

89

90 if not args.no_show:

91 cv2.namedWindow('Human Pose Estimation Demo', cv2.WINDOW_AUTOSIZE) # 2021/0819

92 cv2.imshow('Human Pose Estimation Demo', frame)

93 key = cv2.waitKey(delay)

修正なし

$ vi ~/omz_demos_python/colorization_demo/python/colorization_demo.py

152 log.debug("Show results")

153 cv.namedWindow('Colorization Demo', cv.WINDOW_AUTOSIZE) # 2021/0819

154 cv.imshow('Colorization Demo', final_image)

155 key = cv.waitKey(1)

156 if key in {ord("q"), ord("Q"), 27}:

$ vi ~/omz_demos_python/deblurring_demo/python/deblurring_demo.py

144 if not args.no_show:

145 cv2.namedWindow('Deblurring Results', cv2.WINDOW_AUTOSIZE) # 2021/0819

146 cv2.imshow('Deblurring Results', final_image)

147 key = cv2.waitKey(1)

:

170 if not args.no_show:

171 cv2.namedWindow('Deblurring Results', cv2.WINDOW_AUTOSIZE) # 2021/0819

172 cv2.imshow('Deblurring Results', final_image)

173 key = cv2.waitKey(1)

修正なし

C++ プログラムの修正 †

$ vi /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/text_detection_demo/cpp/main.cpp

342 if (!FLAGS_no_show) {

343 cv::namedWindow("Press ESC or Q to exit", cv::WINDOW_AUTOSIZE); // 2021/0819

344 cv::imshow("Press ESC or Q to exit", demo_image);

345 int key = cv::waitKey(1);

$ vi /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/crossroad_camera_demo/cpp/main.cpp

834 if (!FLAGS_no_show) {

835 cv::namedWindow("Detection results", cv::WINDOW_AUTOSIZE); // 2021/0819

836 cv::imshow("Detection results", frame);

837 const int key = cv::waitKey(1);

$ vi /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/human_pose_estimation_demo/cpp/main.cpp

313 if (!FLAGS_no_show) {

314 cv::namedWindow("Human Pose Estimation Results", cv::WINDOW_AUTOSIZE); // 2021/0819

315 cv::imshow("Human Pose Estimation Results", outFrame);

316 //--- Processing keyboard events

317 int key = cv::waitKey(1);

:

338 videoWriter.write(outFrame);

339 }

340 if (!FLAGS_no_show) {

341 cv::namedWindow("Human Pose Estimation Results", cv::WINDOW_AUTOSIZE); // 2021/0819

342 cv::imshow("Human Pose Estimation Results", outFrame);

343 //--- Updating output window

344 cv::waitKey(1);

$ vi /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/object_detection_demo/cpp/main.cpp

398 if (!FLAGS_no_show) {

399 cv::namedWindow("Detection Results", cv::WINDOW_AUTOSIZE); // 2021/0819

400 cv::imshow("Detection Results", outFrame);

401 //--- Processing keyboard events

402 int key = cv::waitKey(1);

:

426 }

427 if (!FLAGS_no_show) {

428 cv::namedWindow("Detection Results", cv::WINDOW_AUTOSIZE); // 2021/0819

429 cv::imshow("Detection Results", outFrame);

430 //--- Updating output window

431 cv::waitKey(1);

修正なし

$ vi /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/pedestrian_tracker_demo/cpp/main.cpp

205 }

206 if (should_show) {

207 cv::namedWindow("dbg", cv::WINDOW_AUTOSIZE); // 2021/0819

208 cv::imshow("dbg", frame);

209 char k = cv::waitKey(delay);

「2021.4」版では削除(「イメージ処理 C++ デモ」に統合)

$ /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/interactive_face_detection_demo/cpp/main.cpp

325 if (!FLAGS_no_show) {

326 cv::namedWindow("Detection results", cv::WINDOW_AUTOSIZE); // 2021/0819

327 cv::imshow("Detection results", prev_frame);

328 int key = cv::waitKey(delay);

$ vi /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/gaze_estimation_demo/cpp/main.cpp

188 if (!FLAGS_no_show) {

189 cv::namedWindow(windowName, cv::WINDOW_AUTOSIZE); // 2021/0819

190 cv::imshow(windowName, frame);

191

192 // Controls the information being displayed while demo runs

193 int key = cv::waitKey(delay);

$ vi /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/security_barrier_camera_demo/cpp/main.cpp

363

364 cv::namedWindow("Detection results", cv::WINDOW_AUTOSIZE); // 2021/0819

365 cv::imshow("Detection results", firstGridIt->second.getMat());

366 context.drawersContext.prevShow = std::chrono::steady_clock::now();

367 const int key = cv::waitKey(context.drawersContext.pause);

$ vi /opt/intel/openvino_2021/deployment_tools/open_model_zoo/demos/image_processing_demo/cpp/visualizer.cpp

143 void Visualizer::disableTrackbar() {

144 if (isTrackbarShown) {

145 cv::destroyWindow(winName);

146 isTrackbarShown = false;

147 // cv::namedWindow(winName);

148 cv::namedWindow(winName, cv::WINDOW_NORMAL); // 2021/0819

149 show();

150 }

修正なし

更新履歴 †

参考資料 †